¿Qué es el algoritmo de Google?

Google es el buscador más popular y el que más contenido indexa en tiempo real. Para ofrecer unos resultados de calidad que lo mantengan en esa posición, implementa nuevas mejoras en la manera de rastrear, clasificar e indexar los sitios web en sus SERP. Es aquí cuando intervienen los algoritmos de Google.

Google actualiza sus algoritmos más de 500 veces al año, lo que supone una actualización cada 17 horas aproximadamente. La mayoría de estas actualizaciones o cambios son de poca relevancia y no suelen cambiar mucho los resultados de búsqueda y sus posiciones, solo corrigen ciertos errores o mejoran la eficiencia de Crawler.

En cambio, hay actualizaciones de mayor importancia que pueden hacer que el posicionamiento en las SERPs se vea afectado. Esto puede darse por actualizaciones de algoritmos ya existentes o por la integración de nuevos algoritmos. Todas las actualizaciones del algoritmo de Google las tienes aquí.

Pero ¿Qué es un algoritmo de Google?

Los algoritmos son aplicaciones informáticas creadas por Google de una gran complejidad que rastrean e indexan sitios web para añadirlos a las páginas de resultados. Su misión es la de emular una moderación «humana» de forma que a través de sus diferentes vertientes consiga clasificar de forma automática y de la más sensata y justa posible, los sitios webs más relevantes en base a los criterios empleados por sus usuarios.

¿Cómo funciona un algoritmo de Google?

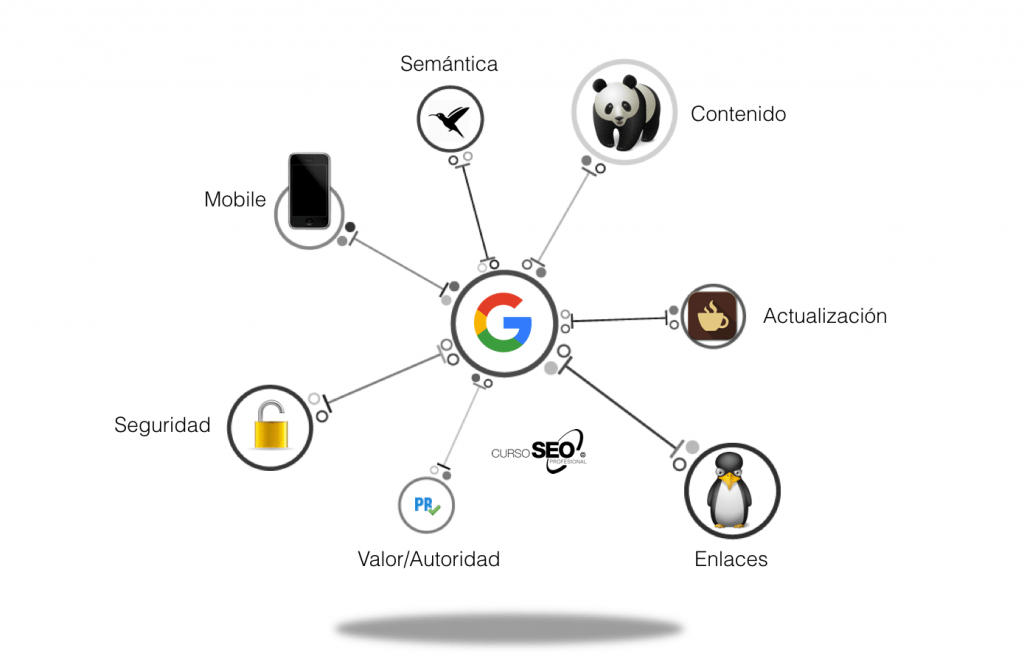

Un algoritmo de Google tiene como función clasificar en qué posiciones aparecerá un sitio web. El algoritmo decide en qué posición va a estar tu web. Cada algoritmo tiene encomendada una tarea y un tipo de área que debe analizar. En función de la capacidad o acierto que hayamos tenido a la hora de cubrir los requisitos del algoritmo en cuestión, este decidirá en qué posición de la SERP va a mostrarse el sitio web.

Cada algoritmo analiza una parte del sitio web (on page) y lo que sucede fuera de ella (off page), siguiendo unos requisitos y unas variables que van modificándose o mejorando en cada actualización que Google hace sobre ellos.

Los Algoritmos más conocidos de Google:

Mobile-first

Google cada vez se pone más riguroso con las búsquedas en dispositivos móviles. Desde su blog oficial advirtió que «Mobile-first no va a cambiar la manera en la que se calcula el posicionamiento de una web, si no la manera en la que se procesa la información de esa web» (Por ahora).

Del mismo modo, también comunicaron que las versiones para móvil más adecuadas son las responsive y no las versiones específicas para móvil (del tipo m.dominio.com). Esto se debe a que quieren que las webs muestren el mismo contenido para todos los dispositivos. Asimismo, las páginas no adaptadas para móviles o con una velocidad de carga lenta tendrán menos visibilidad en el buscador.

Para comprender exactamente por qué este algoritmo se llama Mobile First, la explicación es sencilla.

Antes el robot de Google añadía las páginas a su índice a partir de la clasificación que el algoritmo le daba analizando la versión de escritorio. Con la nueva actualización el índice pasará a mostrar resultados según rastree y califique la versión móvil del sitio.

¿Qué implica esto para nuestra web?

Bueno, esta actualización nos afecta de diferente forma en función de cómo sea la versión móvil de nuestra web.

- Si solo disponemos de una versión para escritorio (No es responsive)

Debes realizar un rediseño web lo antes posible. Este tipo de webs aumentan en gran medida la tasa de rebote debido al gran número de usuarios móviles que existen hoy día y, del mismo modo; la web estará perdiendo posiciones por esto. En poco tiempo el posicionamiento se verá más afectado aún, debido a este algoritmo.

- Si tienes una versión móvil en URL independiente (m.misitio.com)

La web comenzará a perder posiciones, ahora que Google comenzará a rastrear las webs desde su versión móvil, todo el contenido que falte en la versión móvil respecto a la de escritorio nunca va a ser detectado.

- Si tu web es responsive

No debes de preocuparte por nada, son los estándares de calidad web que Google quiere en sus resultados.

Actualización «Brackets»

Los cambios en los resultados se notaron con el comienzo de marzo de 2018. Google no lo había confirmado aún, pero muchos de los expertos en SEO empezamos a escuchar rumores y ver el posicionamiento de sitios web caer. Más tarde, una trabajadora de Google en Twitter le pusó el nombre de Brackets y comentó que no era una actualización que buscase castigar sitios. Más bien era una actualización rutinaria del núcleo de Google, que sucede dos veces al año y que compensará a los sitios web que hasta ahora han sido poco recompensados.

Esta actualización ha potenciado el posicionamiento de sitios web que antes no se veían beneficiados pese a su contenido de calidad y su trabajo duro por subir en las SERPs, por lo que ha primado la calidad del contenido que ofrece el sitio web. También se han visto beneficiados sitios web que tienen configuradas tarjetas enriquecidas. Todo esto da como resultados un mejor CTR. Todo esto es lo que parece ser que Google ha tenido en cuenta a la hora de actualizar el core, ya que por su parte no ha confirmado de que se trataba la actualización.

¿Cuáles son los algoritmos de Google?

Google Penguin y Google Panda

Debido a la importancia que tienen estos algoritmos, hemos dedicado un capítulo solo para explicaros cómo funciona el algoritmo de Google Panda y Google Penguin.

Google Fred

En 2017 salió a la luz una actualización no confirmada por parte de Google, aunque hubo trabajadores que hicieron referencia al tema en la red de Twitter haciendo bromas y sugiriendo que a esta actualización podría llamarse «Fred». Se le podría considerar similar a Google Panda, ya que Google Fred rastrea y califica el contenido teniendo en cuenta la calidad y cantidad de los backlinks, el uso abusivo de publicidad (con el único objetivo de obtener dinero sin aportar realmente nada de utilidad para el usuario), sitios con una mala usabilidad y estructuración de la web o contenido escaso y de poca calidad. Influyendo esto en las posiciones del sitio web en los resultados de búsquedas. El objetivo claramente es penalizar las redes de monetización de contenido.

Google Owl

El objetivo de este algoritmo lanzado en abril de 2017 es incluir solamente en las SERPs noticias y artículos reales. De esta manera se excluiría contenido falso y desagradable, que pueda contener violencia, contenido sexual explícito, u otras cuestiones ofensivas. Para esto Google también mejoró e incluyó con la actualización del algoritmo, en el apartado de autocompletar de su barra de búsqueda, un enlace que abre un formulario desde el que se puede denunciar sugerencias de predicciones inadecuadas.

Mobile Friendly

Dado el creciente número de usuarios de dispositivos móviles y que más del 60% de las búsquedas a través de Google se realizan en dispositivos móviles o tablets, Google decidió tomar cartas en el asunto lanzando una nueva actualización de algoritmo en 2015 llamada Mobile Friendly.

La importancia de un buen funcionamiento en dispositivos móviles para Google se ve plasmada en la gran cantidad de factores de posicionamiento que giran en torno a estos.

Hemos decidido aunarlos todos en esta sección.

- Un buen diseño responsive que permita una navegación cómoda. (Lectura fácil, botones grandes, estética limpia)

- Poco peso (Si cargamos la web desde una red móvil como 3G o 4G puede tardar más de la cuenta)

- Imágenes y elementos encuadrados

- Poco CSS a ser posible, nada de Flash.

Podemos conocer si Google interpreta nuestra web como «Mobile Friendly» o no desde Google Search Console.

Hasta ahora que nuestra web tenga un buen posicionamiento orgánico en escritorio no implica que lo tenga en móvil. Esto se debe a que son procesadas por separado ofreciendo así al usuario la mejor experiencia según el dispositivo.

Si nuestra web se dedica a la publicación de noticias o artículos, también podemos considerar la implementación del AMP. Este estándar elimina en casi su totalidad el Javascript, CSS y comprime el HTML provocando que la velocidad de carga sea muy alta a cambio de un estilo visual más plano.

Google Pigeon

En el 2014 Google lanzó este algoritmo que se encargaría de rastrear y calificar a negocios online que practicaban SEO local. Google Pigeon ha sido lanzado con la intención de beneficiar tanto a usuarios como directorios web locales, con la idea de mostrar a los usuarios resultados más acertados a sus búsquedas.

A causa de quejas por parte de Yelp, uno de los directorios web más conocidos e importantes, Google decidió lanzar este algoritmo y así aprovechar y mejorar los resultados ofrecidos a los usuarios ya que los cambios que traía este nuevo algoritmo no afectaban solo a los resultados de búsqueda orgánica sino también a los resultados de Google Maps y Google My Business.

Google Pigeon rastrea y califica en base a la calidad del contenido, la velocidad de la web, la usabilidad y estructuración del sitio, comprueba si todas las prácticas de SEO son White Hat, si existiese contenido duplicado y si los enlaces externos le aportan calidad y valor al sitio web.

Google Payday Loan

Con la llegada de este algoritmo en 2013 se pretende limpiar y filtrar los resultados de búsqueda que tienen tendencia a contenido con SPAM, técnicas ilegales de SEO, la pornografía, medicamentos y similares.

Este algoritmo se lanzó primero en Estados Unidos donde Google revela que solamente 0,3% de los resultados se vieron afectados. En los siguientes meses en los que el algoritmo se actualizó en el resto del mundo, se detectó que en las consultas de búsquedas realizadas desde Turquía afectó al 4%, ya que en es un mercado donde se mueve contenido más fraudulento. Es por eso que esta actualización no afectó por igual a las diferentes ubicaciones, porque esto dependía del tipo de mercado de cada lugar.

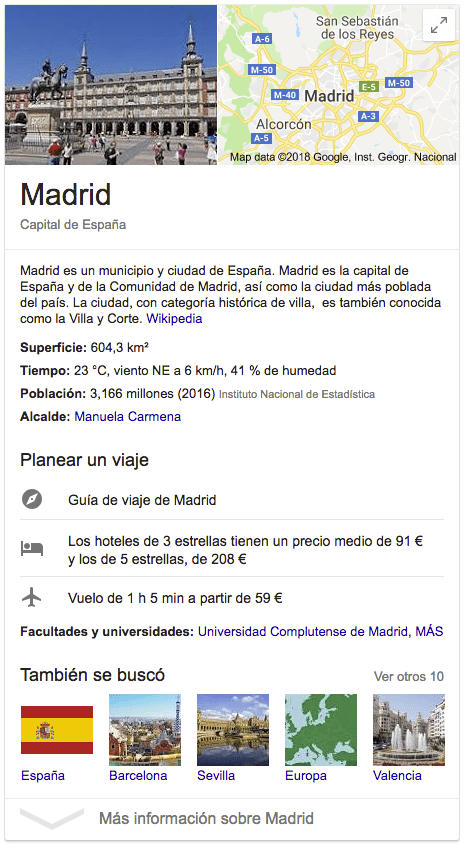

Google Knowledge Graph

Esta actualización lanzada en mayo de 2012 dotó a Google de mayor conocimiento, quitándole la limitación de tratar las consultas como simples términos. Con esta actualización del algoritmo de Google, cada consulta realizada por el usuario referente a una ubicación personaje célebre o eventos, etc; Google no solo muestra los resultados orgánicos si no información semántica que ha encontrado y recogido de diferentes web, como wikipedia por ejemplo.

Captura de resultado con información semántica.

Google Venice

Se presenta en febrero de 2012 un cambio en el algoritmo de Google Venice. Con este cambio Google quería facilitar a sus usuarios las búsquedas locales en los resultados orgánicos, por lo que los negocios locales se verían beneficiados con esta nueva actualización. Para que entendamos mejor cómo facilitó este algoritmo la búsqueda a los usuarios, estos para hacer una búsqueda de unas clases de yoga en su ciudad por ejemplo antes tenían que poner «Clases de yoga en Madrid» a partir de dicha actualización, los usuarios solo tenían que buscar por el término clases de yoga y Google mostraría los resultados en función de la ubicación.

Google Page Layout

Este algoritmo se reveló de manera oficial dos meses después de su lanzamiento en 2012 a través de Matt Cutts. El cometido de Google Page Layout era el de evitar mostrar al usuario sitios web que se mostraban en la parte superior de las páginas con múltiples anuncios, obligando al visitante a hacer un scroll infinito hasta llegar al contenido y ofreciéndole como consecuencia una baja experiencia de usuario.

Google Hummingbird

Este algoritmo, que se actualizó en 2010, es algo más avanzado que los demás. Su objetivo es comprender correctamente las búsquedas complejas clasificándolas según el contexto para ofrecer al usuario justo lo que está buscando.

Para usar este algoritmo a nuestro favor, debemos aplicar una buena técnica de Longtail consiguiendo así mejores posiciones en los resultados de búsquedas en los que se hayan empleado palabras clave más complejas.

Esta actualización del algoritmo se pensó para así cubrir la carencia que Google Panda tenía en comprender que no debía mostrar los mismos resultados para diferentes preguntas o usos de las llamadas «cadenas clave de cola larga» (Longtail). Estas keywords son cada vez más usadas debido al uso del móvil y las búsquedas por voz. Dotando a Google Hummingbird de la capacidad de saber responder de diferente manera a preguntas de ¿Dónde? o ¿Qué? lo que es conocido como «los momentos del usuario».

Google Caffeine

En agosto de 2009 con el lanzamiento de este algoritmo de Google, mejoró la velocidad del rastreo de las arañas, consiguiendo así su objetivo, que era mostrar resultados con contenido actual de forma más rápida a sus usuarios. Como beneficio para los webmasters esto aceleró el proceso de indexación de las páginas.

Más que una actualización de algoritmo que alterase las clasificaciones, era un cambio en la forma de indexar de las arañas para poder mostrar a los usuarios información más relevante a sus consultas.

Google Vince

Esta actualización de algoritmo fue una de las primeras (2009), y se lanzó para favorecer a las marcas conocidas en el mundo offline que emplearan buenas prácticas de SEO. Según dijo el Matt Cutts «las marcas son la solución, no el problema y tienen un valor fundamental para los humanos».

Con esto, marcas como por ejemplo vodafone, Sony y más; se vieron beneficiadas en el ranking para búsquedas con términos muy competidos como móvil o similares.

Google Everflux ¿Qué es?

Llegados a este punto ya conocemos el núcleo de Google al completo y la cantidad de actualizaciones que recibe y cómo afecta esto al movimiento de las posiciones en los sitios web.

La fluctuaciones o variaciones que se perciben continuamente en las SERPs se conoce como Google Everflux (antiguamente conocido como «Google dance»), y se refieren tanto a variaciones mínimas que pueden notarse con una actualización rutinaria hasta variaciones más notables que pueden darse con una gran actualización y cambio en el core.

Este capítulo se mantendrá actualizado con cada nueva actualización que se detecte en los algoritmos de Google, confirmada o no de forma oficial por parte del gran buscador.

Historial de actualizaciones de Algoritmos de Google desde el año 2009

¿Te gustaría conocer todas las actualizaciones de los algoritmos de Google desde el año 2009? haz click aquí.

![Curso SEO online – El mejor curso de SEO [2024]](https://cursoseoprofesional.com/wp-content/uploads/2022/01/cropped-cropped-logo-blanco-horizontal_brillo.png)

muchas gracias por el curso, es muy útil para aprender.

Gracias Esme, me alegra saber que te está siendo útil.

Quiero registrarme y no encuentro donde. En los videos dice que si nos registramos accedemos a mas info pero no se donde.

Gracias!